🖥️ #88: Agenci AI pod maską

+ GPT 5.3 Codex, Opus 4.6, Agent Teams, Gemini 3 Deep Think i poradnik dla Agent Skills

Siema!

Mój nowy film Agenci AI pod maską już dostępny na YouTube!

Wiem wiem, wszyscy już o tych agentach…

Większość materiałów skupia się jednak na automatyzacji w n8n albo na Cursorze czy Claude Code. Ja postanowiłem podejść do tego od trochę innej strony i sprawdzić, jak taki agent faktycznie działa od środka.

W filmie omawiamy działanie narzędzi, function calling, workflows, agent loop i inne. Programujemy też swojego agenta od zera. Dużo mięsa w przystępnej formie.

Przyda Ci się, jeśli sam planujesz budować agentów albo żeby lepiej zrozumieć narzędzia AI, z których korzystasz na co dzień.

Miłego oglądania :)

GPT-5.3-Codex & Opus 4.6

O bogowie, walka! W jednym dniu miały premierę topowe modele od dwóch kluczowych graczy: Anthropica i OpenAI. Główny nacisk położono na umiejętności w programowaniu.

Stało się to dość niespodziewanie. Podczas gdy wszyscy spodziewali się wydania nowego modelu z serii Sonnet, Anthropic postanowił wydać nową wersję tego mądrzejszego LLMa. Co ciekawe, premiera zbiegła się z zastrzykiem gotówki dla Anthropica w wysokości 30 miliardów dolarów, przy wycenie 380 miliardów.

OpenAI z kolei, będące od miesięcy na przegranej pozycji, postanowiło zawalczyć o miano lidera nowym modelem z dopiskiem Codex. Nie mylić z aplikacją Codex, która jest narzędziem będącym konkurencją dla np. Claude Code, ehh trudne to nazewnictwo :)

Jak wyszło?

Wydajnościowo oba modele stoją na bardzo podobnym poziomie. W benchmarkach nieco lepszy okazuje się Codex, ale ciężko jednoznacznie stwierdzić, który model jest lepszy, o tym jednak w dalszej części.

Zacznijmy od Opusa. Wersja 4.6 przyniosła kilka fajnych zmian. Po pierwsze tzw. Adaptive Thinking, czyli automatyczne wykrywanie tego, kiedy model powinien się bardziej zmóżdżyć (extended thinking). Dostaliśmy również opcję zmiany Effort, czyli wysiłku, jaki model ma podjąć, aby rozwiązać problem.

Sporo mówiło się o tym, że okno kontekstowe Opusa to aż 1 milion tokenów - dla modelu tej klasy to duże zaskoczenie. Szkoda, że nie jest to do końca prawda. Bazowo model posiada standardowe 200k tokenów, a milion dostępny jest w fazie beta. Większy kontekst powiązany jest również z nową funkcją Context Compaction, czyli automatycznym kondensowaniem informacji tak, żeby zmieściły się w context window. Szkoda.

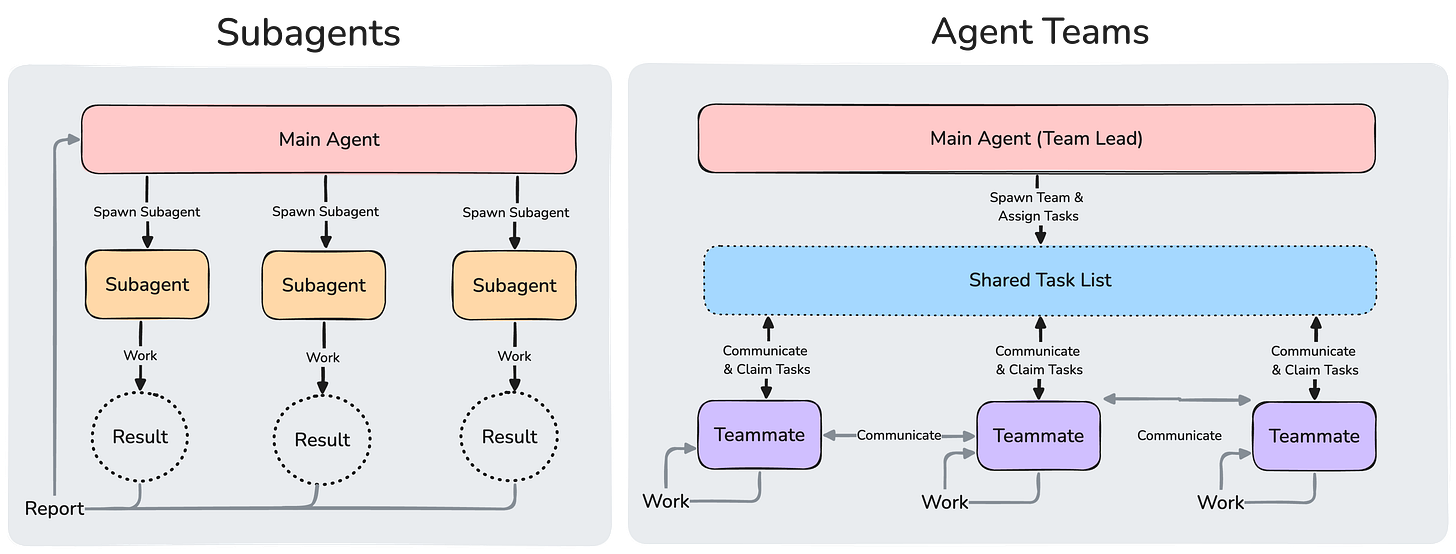

Ciekawą nowością są za to Agent Teams, czyli nowy sposób na równoległą pracę agentów nad jednym zadaniem. Są pomysłem zbliżonym do Subagentów, z tą różnicą, że tutaj każdy członek zespołu może się ze sobą komunikować.

Anthropic jako przykład wykorzystania teamów pokazał, że udało im się zbudować kompilator języka C. Co prawda miał on swoje problemy, ale to nadal bardzo imponujące. Zrobili to w zaledwie dwa tygodnie wydając $20k. Agent Teams są dostępne w wersji eksperymentalnej, uwaga bo mogą pożreć sporo tokenów.

Wady Opusa 4.6? Jest niesamowicie drogi. Polecam bardzo uważać na usage i dobierać modele rozsądnie, bo można się obudzić z wykorzystanym planem bardzo, ale to bardzo szybko. À propos szybkości, nie jest ona największą zaletą Opusa. Model jest stosunkowo wolny. Anthropic postanowił nawet coś z tym zrobić i zaproponował opcję Fast, która jest 2,5 raza szybsza. Niestety jest piekielnie droga.

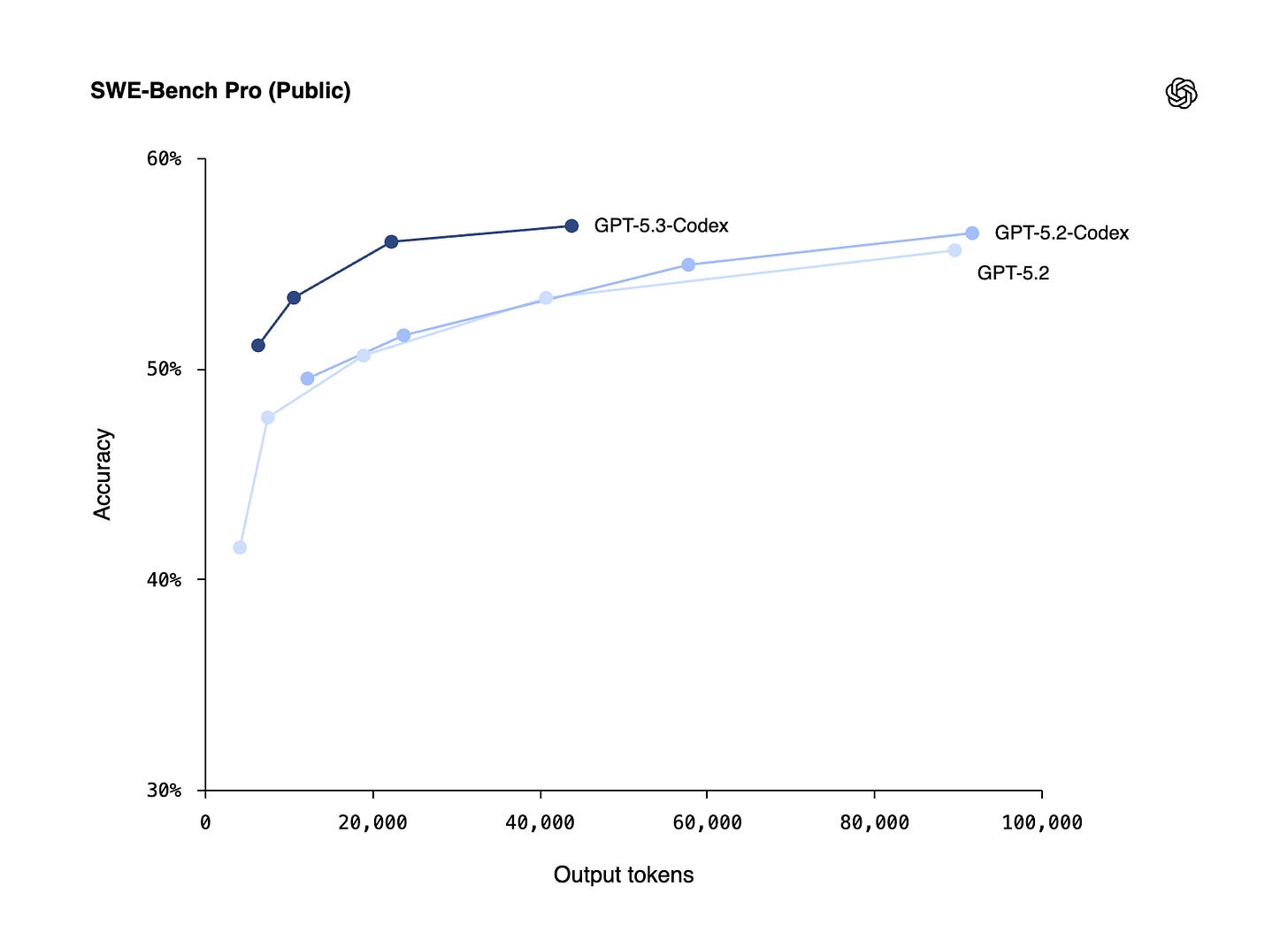

Wracając do OpenAI. GPT-3.5-Codex to naprawdę bardzo dobry model. Prezentuje się świetnie w benchmarkach, jest zdecydowanie szybszy zarówno od swojego poprzednika (nawet o 25% per token), jak i konkurencji w postaci Opusa.

Ciekawą funkcją jest tzw. Steering, czyli interakcja z modelem w trakcie wykonywania zadania. Zamiast czekać na jego skończenie, możemy wtrącić np. nowe wymaganie podczas trwającej generacji.

Kilka dni temu pojawił się również mniejszy, ale jeszcze szybszy model - GPT-5.3-Codex-Spark, który pozwala generować nawet 1000 tokenów na sekundę. To 15 razy szybciej niż wersja Fast Opusa, ale to trochę inne sposby na zwiększanie szybkości. Spark jest słabszym modelem z mniejszym oknem kontekstowym (128k). Na razie nadal znajduje się w fazie testów, ale w przyszłości może fajnie współpracować ze starszym bratem w formie: jeden planuje, drugi robi.

Moje wnioski i wrażenia z community są takie, że akurat w tym przypadku nie mamy jednoznacznego zwycięzcy.

Z jednej strony GPT-5.3-Codex wydaje się lepszym modelem do kodowania overall. Z drugiej Anthropic wygrywa toolingiem w postaci Claude Code czy większą gamą planów cenowych. Spotkałem się również z opiniami o różnym sposobie pracy z tymi modelami. Codex ma lepiej rozpykiwać zadania end-to-end, podczas gdy Opus skupia się na mniejszych iteracjach. Chociaż wiadomo, zależy to też od tego, czym taki model nakarmimy.

OpenAI powoli wstaje z kolan i bardzo dobrze. Większa konkurencja to dla nas same plusy. Przed nimi jeszcze długa droga do zdobycia serc deweloperów, ale zaczęli nieźle. Teraz liczą się narzędzia i ich integracja z modelami. Jeśli usprawnią swojego Codexa (aplikację, nie model), to mogą na poważnie powalczyć z Anthropiciem.

Gemini 3 Deep Think

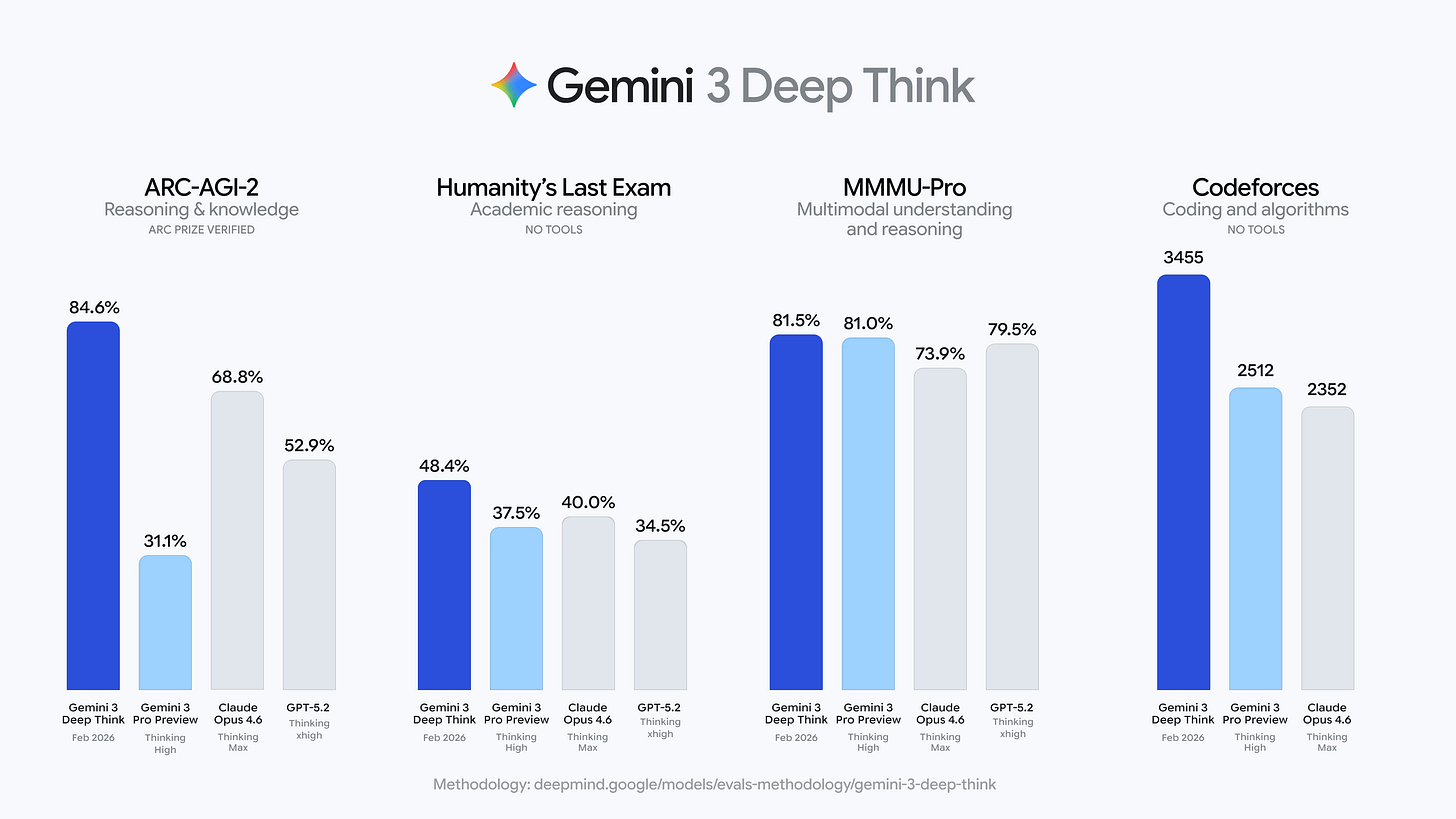

Gdy dwóch się kłóci, tam Google przygotowuje potężnego potworka w piwnicy. Wersja Deep Think ma być najbardziej zaawansowanym modelem ever (surprise, surprise), skupionym na rozwiązywaniu skomplikowanych problemów w matematyce, inżynierii i nauce.

Prezentuje się świetnie w benchmarkach, np. osiągając kosmiczne 84,6% w ARC-AGI-2 (dla porównania Gemini 3 Pro wykręca ~31%, a Opus 4.6 ~70%).

Model wydaje się skupiać na naukowych zadaniach. Google wspomina, że bardzo dobrze daje sobie radę z zadaniami z zakresu fizyki czy chemii. Co prawda nie odpuszczają kodowania, ale nie wydaje się być to głównym priorytetem:

We are very much so hill climbing on agentic coding, lots of progress and lots of work still to come.

~ Logan Klipatrick (Technical Staff), X

Deep Think dostępny jest póki co tylko w subskrybcji Ultra, ale niedługo powinniśmy dostać go też w API.

Ciekawe linki

The Complete Guide to Building Skills for Claude

Ponad 30-stronicowy poradnik od Anthropica odnośnie planowania, budowania, testowania i udostępniania Skilli. Zdecydowanie warto rzucić okiem. Jak się uczyć, to od ludzi, którzy wymyślili ten standard.

Skills vs AgentsMD: 53% vs 100%. Co poszło nie tak?

No właśnie, jak to jest z tymi Skillami? Hype już nieco opadł, a community w dużej mierze przesiada się na nie z np. MCP czy Rulesów. Nie jest to jednak idealne rozwiązanie i tak jak poprzednicy, ma swoje wady. Pokazują je Przeprogramowani w swoim najnowszym materiale. Co będzie następne?

Cloudflare wprowadza funkcję, dzięki której modele będą mogły łatwiej czytać nasze strony. Zastosowanie nagłówka „Accept: text/markdown” wyśle botowi czysty tekst w formacie Markdown.

Dario Amodei (CEO Anthropic) x Dwarkesh Patel

Bardzo ciekawa rozmowa CEO Anthropica w podcaście Dwarkesha (imo najlepszy podcast o AI obecnie). Dużo o rozwoju LLMów, compute, kasie, przyszłości i planach. Fajnie się tego słucha, szczególnie gdy prowadzący czelendżuje Dario pytaniami, podważając niektóre kwestie :)

Już uciekasz?

Jeśli Ci się podobało, kliknij 🧡 poniżej, to nic nie kosztuje! Doceniasz w ten sposób moją pracę i motywujesz do dalszych działań :)

Do następnego,

Olaf