🖥️ #84: Kryzys w OpenAI

+ standaryzacja AI, Gemini 3 Flash, GPT 5.2 i dziwny zakup Anthropic

Ho ho ho 🎅

Dobrze Cię widzieć na ostatnim, wypchanym do granic długości maila, wydaniu newslettera w tym roku. Będzie co czytać, będą prezenty, a nawet pamiętniki z wakacji. Zanim jednak to wszystko, krótkie podsumowanie…

Oh boy, co to był za rok. Gdzieś w połowie, po wielu latach, zmieniłem środowisko pracy, co było dla mnie ważnym wydarzeniem. W podobnym czasie zacząłem też myśleć o powrocie do tworzenia treści, innych niż ten newsletter.

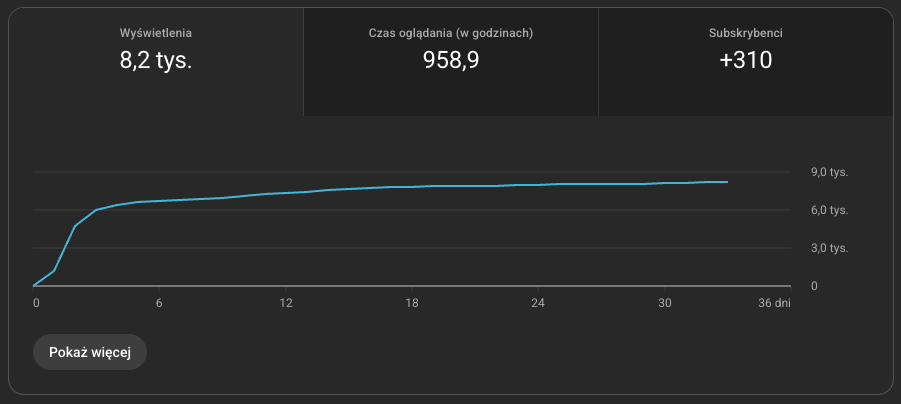

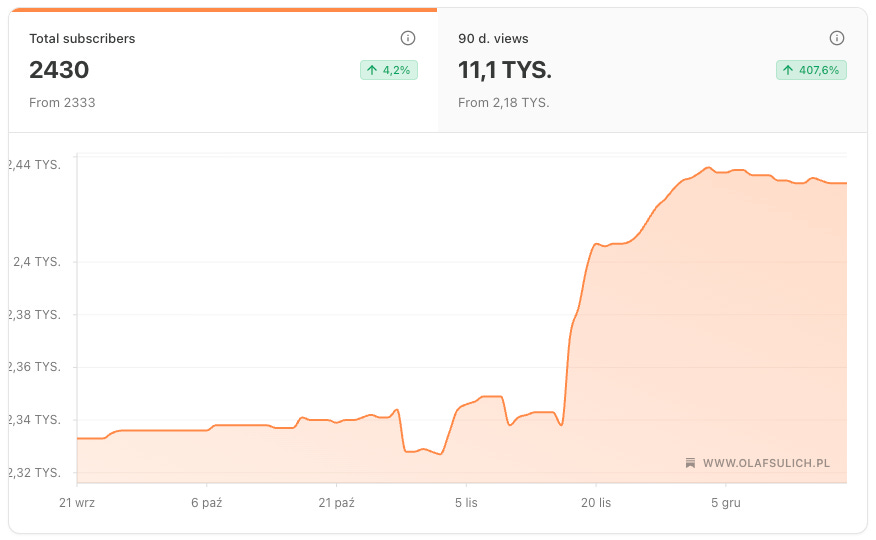

Tak zrodził się kanał na YouTube, o którego założeniu myślałem od wieków. Jeszcze wtedy nie wiedziałem, że produkcja zajmie 3 miesiące 💀 Masa wysiłku, stresu i niepewności jednak się opłaciła. Film, nie wiem jakim cudem, zwyskał ponad 8 tysięcy wyświetleń, a kanale pojawiło się ponad 400 subskrybentów.

Za sprawą filmu na YouTube i “nowego startu”, gruntowną przebudowę przeszedł też ten newsletter. Prowadzę go z różną regularnością od 2020 roku, gdy jeszcze pisałem bloga o programowaniu - frontlive.pl.

Przez te lata newsletter służył mi do dzielenia się moimi treściami i takimi, które wydawały mi się interesujące. Formuła się wyczerpała, mi nie sprawiało już to przyjemności. Stwierdziłem, że to pierd*** i albo zacznę robić coś, na co mam ochotę, albo z tym koniec.

Pivot nie okazał się taki straszny, jak myślałem. Wiele osób, za sprawą zmiany contentu, się odsubowało. No hard feelings. Wiele osób za sprawą filmu i darmowego ebooka dołączyło. Rok kończę bardzo zadowolony, z chęcią do dalszego tworzenia rzeczy, a to dla mnie najważniejsze.

Dzięki za każde wsparcie i do zobaczenia w 2026 :)

Wesołych Świąt i Szczęśliwego Nowego Roku! 🎄🎊

OpenAI nie ma lekko

Druga połowa roku dla twórców ChatGPT nie była kolorowa. GPT-5 okazał się porażką, a próby podratowania sytuacji z GPT-5.1 się nie sprawdziły.

Cała społeczność AI czekała więc na nadejście nowego lidera - Gemini 3. Google dowiózł. Model okazał się dużym sukcesem, spełnił oczekiwania ludzi i stał się tym najlepszym na rynku. Do świetnego modelu doszły też usprawnienia do Nano Banana, które jest w ścisłej topce modeli generowania/edycji zdjęć.

Po premierze Gemini, na początku grudnia, Sam Altman wydał specjalny wewnętrzny alert do pracowników. “Code red” miał na celu skupienie zasobów na usprawnianiu flagowego modelu i odłożeniu niektórych projektów na dalszy plan.

No i doczekaliśmy się GPT-5.2. OpenAI wróciło do topki i razem z Gemini 3 oraz Opus 4.5 (który wyszedł w międzyczasie) stoi na podium. Oficjalne benchmarki wyglądają super, jest jednak jedno “ale”.

Ludzie nie są przesadnie zadowoleni. OpenAI benchmarkowo dogoniło konkurencję, ale to byłoby na tyle. Nie ma żadnego “wow”, nie ma znacznych usprawnień.

Daje to trochę do myślenia i pokazuje, że OpenAI już dawno przestało być tym najlepszym, wyróżniającym się dostawcą modeli na rynku. Teraz razem z innymi firmami, co kilka miesięcy rywalizuje o kilka dodatkowych procent w benchmarkach.

Od wielu miesięcy obserwuję jak ChatGPT zmienia się w cały system operacyjny. Dodatkowe funkcje, połączone aplikacje, ułatwienia życia. Ostatnio ogłosili współpracę z Adobe i np. korzystanie z Photoshopa w czacie:

Gdy myślałem, że w tym roku już nic mnie nie zaskoczy z ich strony, podczas pisania tego wydania, niespodziewanie wypuścili ChatGPT Images - usprawnioną wersję modelu do generowania zdjęć.

Na pierwszy rzut oka wygląda to bardzo dobrze i zdaje się być bezpośrednią konkurencją do Nano Banana, które podbiło rynek. Model zdaje się być dostosowany do edycji i transformacji zdjęć, podobnie jak w modelu Google, powinien dużo lepiej radzić sobie z generowaniem tekstu.

Jak to wyjdzie w praktyce? Dajmy temu trochę czasu, do końca roku na pewno zobaczymy rezultaty. Wątpię, żeby ekipa powtórzyła sukces, gdy ludzie masowo generowali obrazki w stylu Ghibli. Jednak nawet samo dogonienie Nano Banana byłoby czymś dużym

Podsumowując, z jednej strony nie dziwi mnie próba tworzenia mocnego ekosystemu. OpenAI eksperymentuje z dużą ilością mniejszych produktów, które raczej nie grzeją tak, jakby sobie tego życzyli. Nie dziwi, bo wystarczy spojrzeć na Google’a i ich możliwości integracji z narzędziami. Z drugiej wyścig na modele cały czas trwa, a konkurencja przesiadła się z zabawkowych samochodzików na prawdziwe bolidy i już dawno dogoniła pionierów z OpenAI.

Gemini 3 Flash

Google nie zwalnia tempa i po premierze Gemini 3 Pro i nowej wersji Nano Banana prezentuje nowy, tańszy, nieco słabszy, ale szybszy model Flash.

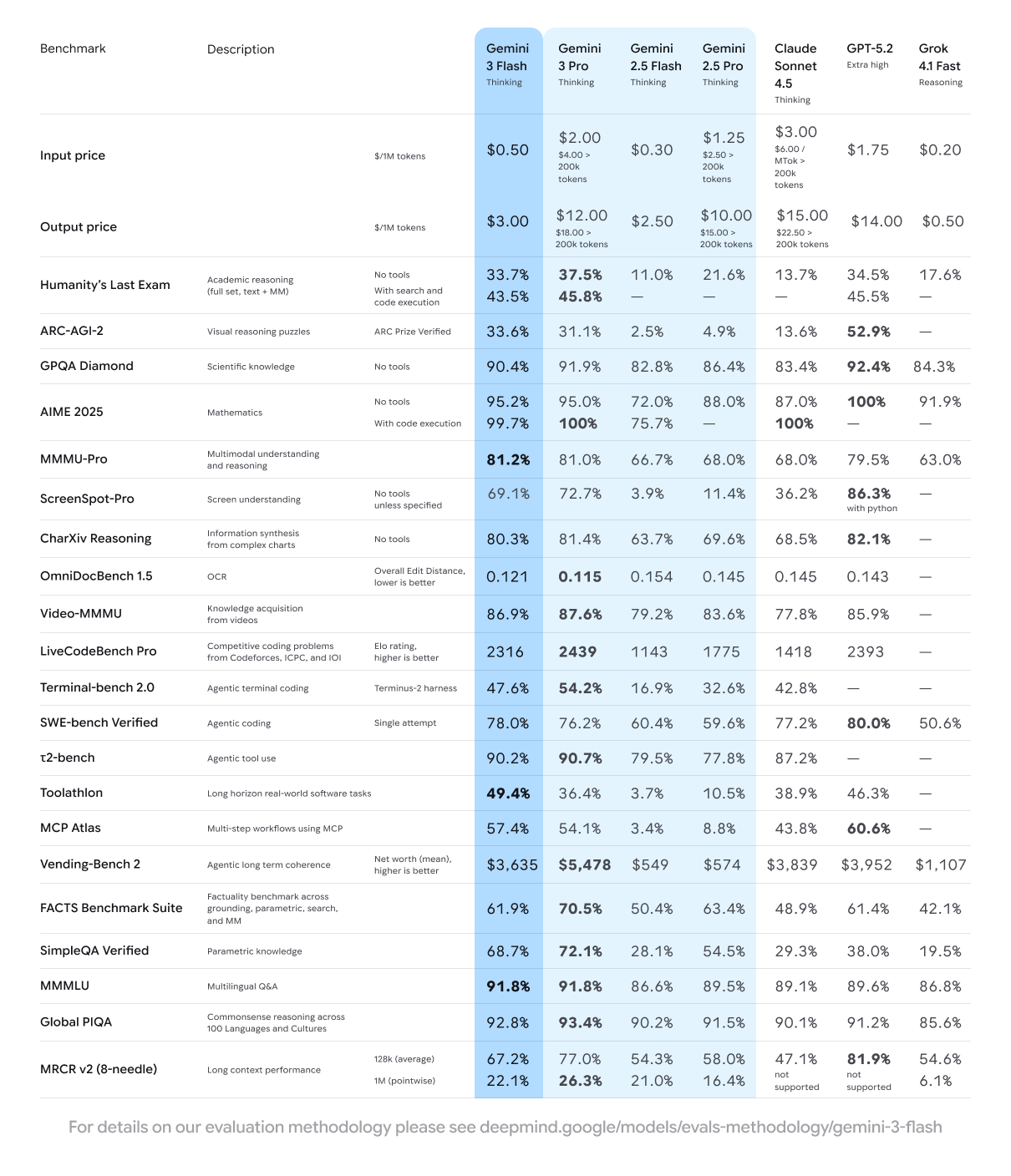

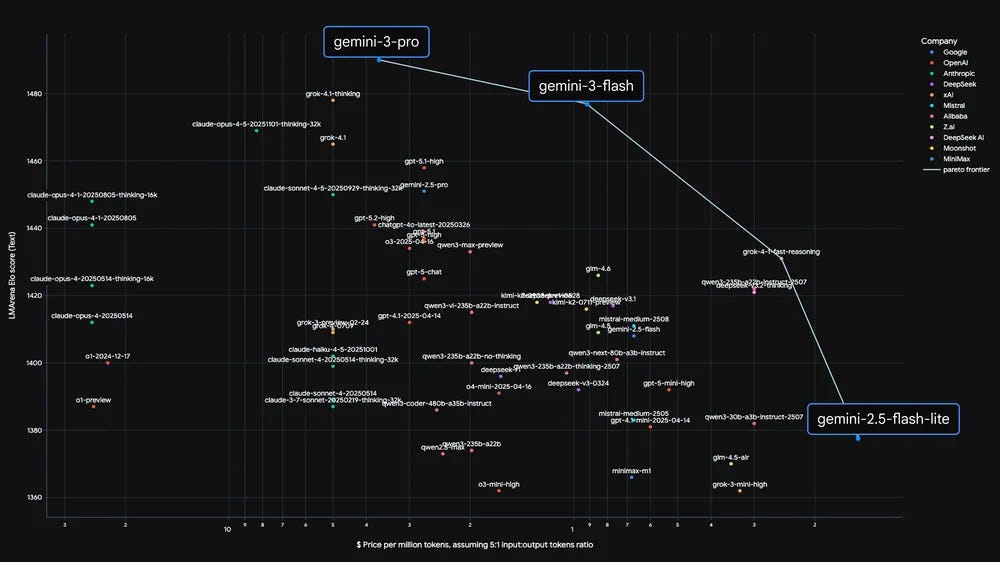

W benchmarkach pokonuje najlepszy model z linii 2.5, jest przy tym od niego 3 razy szybszy i dużo tańszy ($0.50/1M input oraz $3/1M output). Jego poprzednik był świetnym kompromisem pomiędzy wydajnością, szybkością i niską ceną. Do większości zadań będzie na pewno dobrym wyborem.

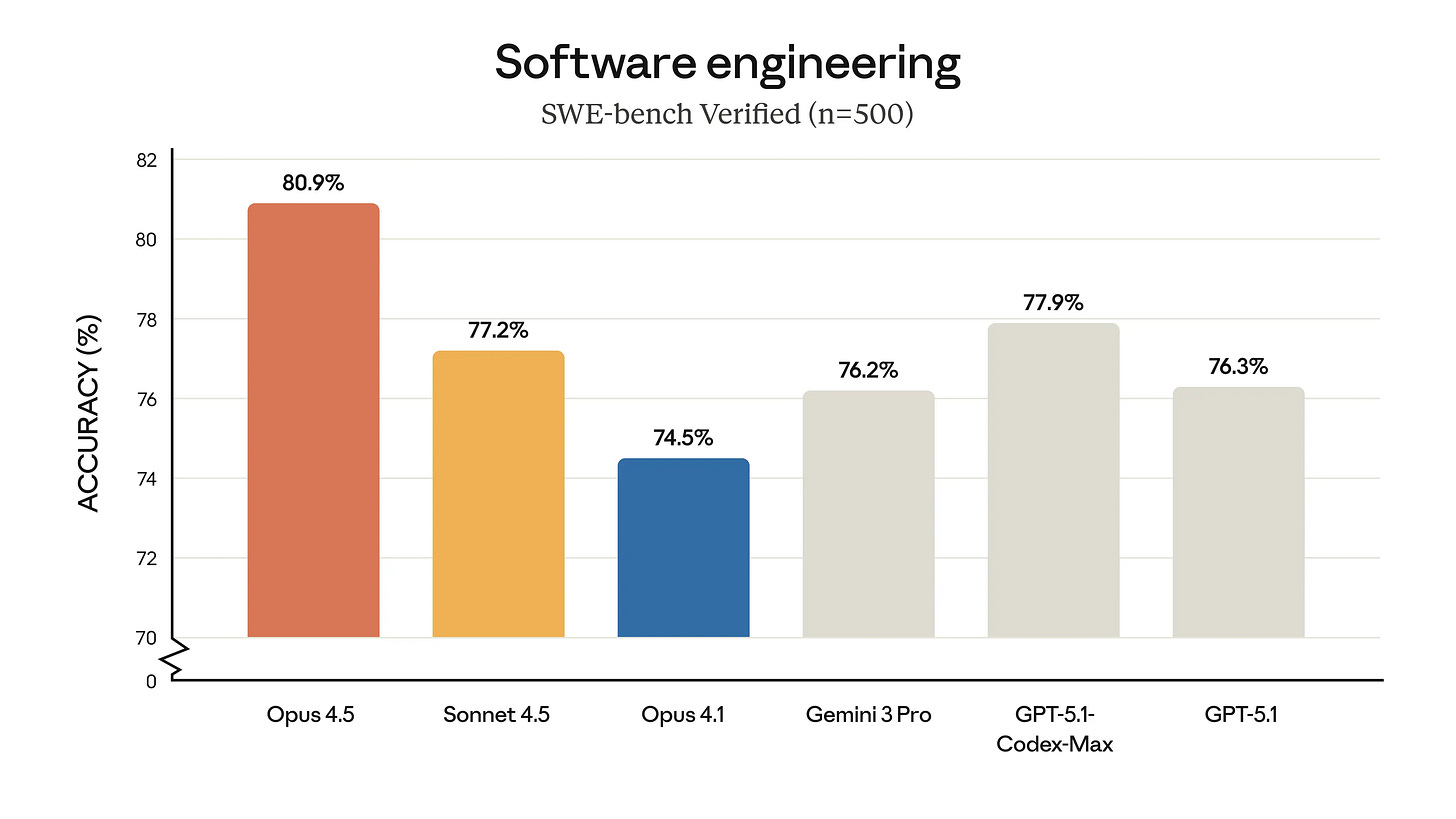

Benchmarki wyglądają bardzo obiecująco, Flash dogania, a momentami nawet wyprzedza topowe modele (co widać np. w teście SWE-bench dotyczącym programowania). Jak jednak wiemy, do takich zestawień należy podchodzić z przymrużeniem oka:

Model został zaprojektowany z myślą o rozumowaniu i multimodalności, zachowując przy tym jak największą wydajność. Jest w stanie rozumować dłużej, zużywając przy tym średnio 30% mniej tokenów od 2.5 Flash.

Czekamy na testy, przez święta na pewno będzie na wylot sprawdzony. Google jest obecnie na fali sukcesów i wróżę, że podobnie będzie z tą premierą. Końcówka roku zdecydowanie należy do nich.

Agentic AI Foundation (AAIF)

Święta to czas przebaczania, miłości i jedności. Do serca wzięli to sobie topowi gracze AI na rynku i złączyli swoje siły pod postacią Agentic AI Foundation. Ekhem Ekhem, no prawie.

AAIF powstało pod Linux Foundation i ma na celu wprowadzenie standardów AI. Członkami fundacji są m.in. Amazon, Google, OpenAI, Anthropic, Cloudflare, Bloomberg, czy Microsoft.

Na start dodane zostały do niej protokół MCP (od Anthropic), AGENTS.md do opisywania kontekstu / instrukcji dla agentów AI do kodowania (od OpenAI), oraz Goose - open source’owy agent.

Dla nas, użytkowników, to przynajmniej w teorii bardzo dobra informacja. Brak standardów w dłuższej perspektywie nie jest niczym dobrym, a połączenie sił twórców modeli może zaowocować nowymi, ustandaryzowanymi toolami.

Anthropic i dziwny zakup

Anthropic wydał nowy model Opus 4.5 w odpowiedzi do Gemini 3. Sam model został przyjęty z entuzjazmem, a jego wyniki są naprawdę bardzo dobre. W tej chwili rywalizuje z Gemini 3 i GPT-5.2 na samym szczycie.

Jednak to nie to zaskoczyło mnie od pomarańczowych w ostatnich tygodniach. Twórcy Claude kupili narzędzie Bun - runtime JavaScript, uwielbiany przez społeczność programistów.

Stało się to w związku z osiągnięciem miliarda dolarów przychodu z Claude Code. Zakup Bun w zamyśle ma być dużym wsparciem dla CC. Dla Bun teoretycznie nic się nie zmieni - nadal pozostanie na tej samej, otwarto-źródłowej licencji, zespół nadal ma rozwijać narzędzie tak, jak wcześniej.

Nie do końca potrafię zrozumieć sens tego zakupu. Ale spoko, trzymam jedynie kciuki za dalszy rozwój Bun. Twórcy w ostatnich latach zrobili niesamowitą robotę. Oby zła korporacja AI tego nie popsuła.

Tym ruchem firma może jeszcze bardziej zbliżyć się do środowiska developerskiego. Pomimo komentarzy CEO, Anthropic jest zazwyczaj domyślnym providerem modeli dla programistów.

Ciekawe linki

Code refactoring z Cursorem - świetne case study od twórców!

Lee Robinson (znany również z Vercela) opisał proces refactoringu strony cursor.com. Głównym celem była zmiana CMS’a na pliki Markdown. Twórca artykułu estymował prace na kilka tygodni, ostatecznie skończyło się na 3 dniach i $250 w tokenach.

Kalendarz adwentowy AI od ElevenLabs

25 Days of Agents, czyli kalendarz adwentowy AI. Każdego dnia dostajemy darmowe kredyty / tier do narzędzi AI. Dostępne są np. N8N, Notion, Railway, Lovable, ElevenLabs…

Film dokumentalny o Google DeepMind

The Thinking Game opowiada historię lab’a DeepMind i Demisa Hassabisa, wizjonera AI w drodze ku AGI. Film pokazuje pięć lat pracy zespołu w londyńskiej siedzibie, w tym kluczowe momenty jak rozwój AlphaGo i AlphaFold.

Tomasz Czajka o pracy w SpaceX, Google, AI i algorytmach szachowych

W podcaście horyzonty Patrycjusza Wyżgi Tomek opowiada o swojej imponującej drodze jako programista w międzynarodowych big techach, sztucznej inteligencji, a nawet “pobocznych projektach”, w których próbuje pobić algorytmy szachowe. Świetna rozmowa.

Wspomnienia z Tajlandii

Kącik małego podróżnika na sam koniec :) Udało mi się totalnie zresetować głowę i wyjechać na dwutygodniowy urlop do Tajlandii.

Na początku podróży trafiliśmy do Oslo, gdzie totalnie zaskoczyła mnie ilość samochodów elektrycznych. Może to przez okolice Oslo i lotniska, ale nie przesadzę, gdy powiem, że większość aut które mijałem to elektryki. Nawet stacje benzynowe nastawione są głównie na ładowanie elektryków.

Odniosłem też wrażenie, że duża jest świadomość technologii (?). Wpadliśmy do kilkupiętrowej biblioteki Deichman Bjørvika (nie, to nie ten od butów), gdzie zobaczyłem sporo ludzi na Macbookach z odpalonym na split screenie ChatGPT. Pomimo masy ludzi, kompletna cisza i spokój, świetne miejsce. Całość dawała taki dość futurystyczny vibe, może przez tą architekturę? Nie wiem, ale do dziś mam to w głowie.

Po Oslo trafiliśmy do Doha, a potem do Bangkoku na dwa dni. Po przejażdżce tuk tukiem, zobaczeniu Chinatown i kilku mniejszych atrakcji, wyruszyliśmy na rajską wyspę Samui.

To miejsce polecam z całego serca. Piękne widoki, przemili ludzie, bardzo dobre i tanie jedzenie, jest co robić, można się też wylegiwać. Normalnie raj na ziemi. Zupełnie inny świat, inne życia, ale zdecydowanie warto się przenieść i zapomnieć na chwilę o całym pędzie, chociaż na moment :)

Już uciekasz?

Jeśli Ci się podobało, kliknij 🧡 poniżej, to nic nie kosztuje! Doceniasz w ten sposób moją pracę i motywujesz do dalszych działań :)

Do następnego,

Olaf